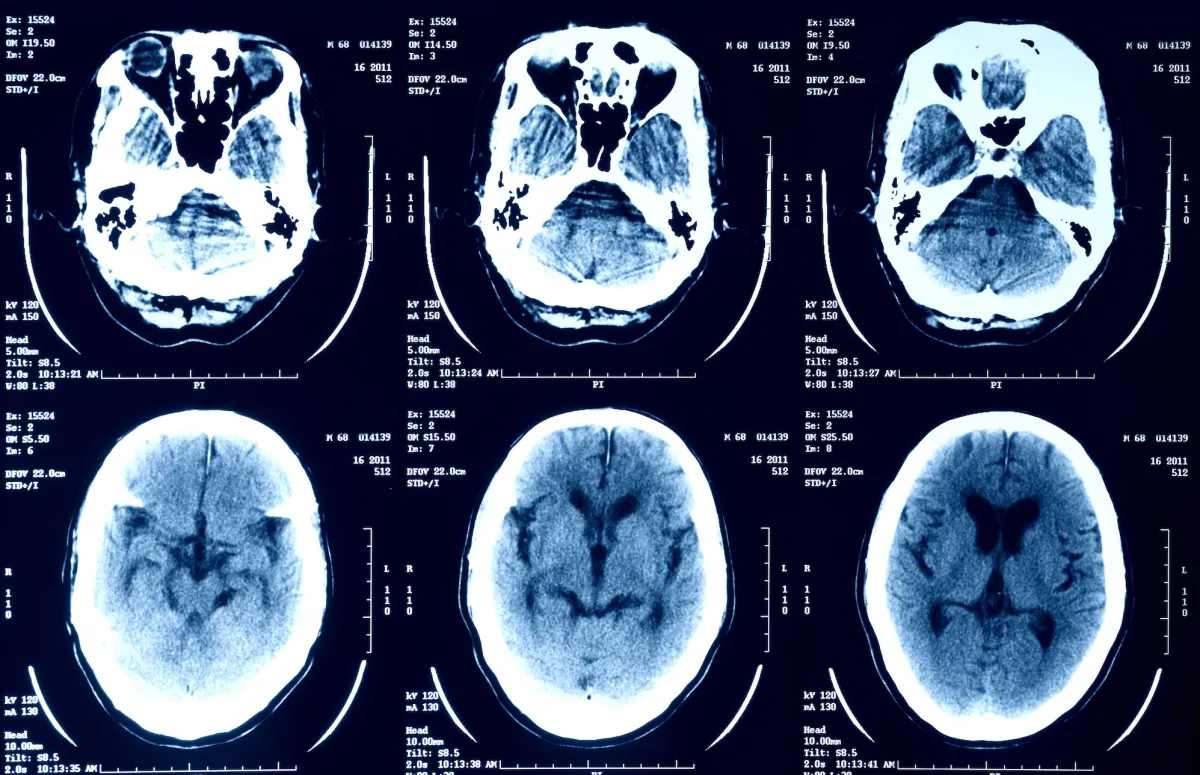

En la actualidad, la inteligencia artificial (IA) se está integrando cada vez más en nuestras vidas, proporcionando soluciones innovadoras en diversos campos, incluido el sector de la salud. Desde aplicaciones que interpretan resultados médicos hasta herramientas avanzadas que ayudan en diagnósticos, los chatbots de IA están demostrando su potencial para transformar el cuidado de la salud. Sin embargo, a pesar de sus beneficios, hay una creciente preocupación sobre la seguridad y la privacidad de los datos médicos. En particular, los usuarios que suben imágenes médicas, como radiografías, resonancias magnéticas (RM) y tomografías por emisión de positrones (PET), a plataformas de IA deben ser conscientes de los riesgos asociados con la protección de su información privada.

¿Por qué no deberías subir tus imágenes médicas a un chatbot de IA?

Cada vez más, personas de todo el mundo recurren a chatbots de IA, como ChatGPT de OpenAI y Gemini de Google, para hacer preguntas sobre sus preocupaciones médicas y comprender mejor su salud. Estos chatbots permiten a los usuarios recibir respuestas rápidas e instantáneas, basadas en vastos volúmenes de datos, sin necesidad de una consulta en persona. Sin embargo, este tipo de interacciones puede ser riesgoso cuando se trata de datos sensibles como los registros médicos.

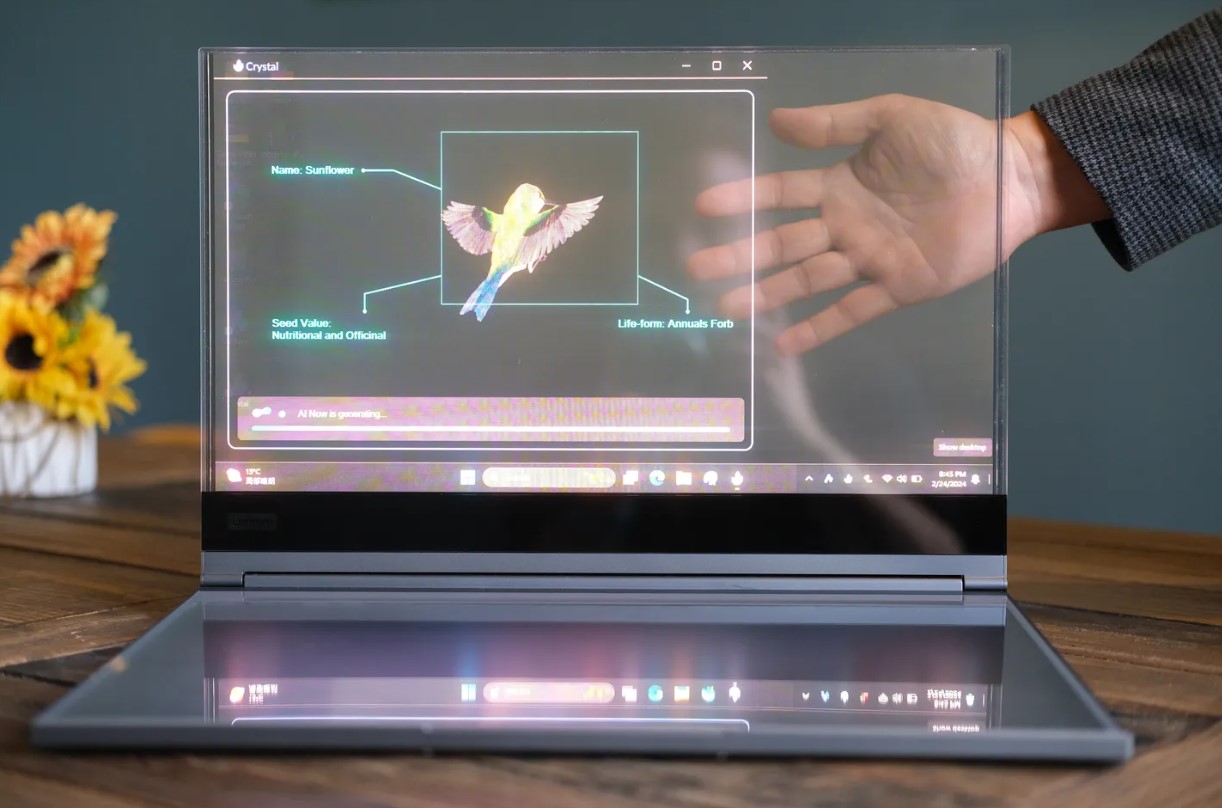

Recientemente, se ha observado que algunas plataformas están alentando a los usuarios a cargar imágenes médicas en sus chatbots de IA para que los algoritmos puedan interpretar los resultados. Un ejemplo es la plataforma X, anteriormente conocida como Twitter, que ha promovido la idea de que los usuarios suban sus radiografías y otros escaneos médicos al chatbot Grok. Sin embargo, este tipo de prácticas genera serias preocupaciones sobre la seguridad de los datos y la privacidad de la información personal.

Riesgos de Subir Imágenes Médicas a Chatbots de IA

- Falta de protección bajo la ley HIPAA

Uno de los mayores riesgos al cargar imágenes médicas en plataformas de IA es que muchas de estas aplicaciones no están cubiertas por las leyes de privacidad médica, como la Ley de Portabilidad y Responsabilidad de Seguro de Salud (HIPAA, por sus siglas en inglés) en Estados Unidos. HIPAA es un conjunto de regulaciones que protege la información médica confidencial de los pacientes y asegura que los proveedores de salud y las aseguradoras sigan prácticas estrictas para salvaguardar la privacidad de los pacientes.

Desafortunadamente, muchas de las aplicaciones de IA que interpretan imágenes médicas no están sujetas a estas regulaciones, lo que significa que tus datos podrían ser compartidos con otras empresas o almacenados en bases de datos sin la debida protección legal. A menudo, los usuarios no son plenamente conscientes de que sus datos están siendo utilizados para entrenar los algoritmos de IA, lo que podría poner en riesgo su privacidad.

- Uso de los datos personales para entrenar IA

Los chatbots de IA, como los de plataformas como OpenAI y X, generalmente utilizan los datos cargados por los usuarios para mejorar sus algoritmos y aumentar la precisión de sus respuestas. Sin embargo, este proceso puede tener implicaciones profundas para la privacidad. Al cargar imágenes médicas, como radiografías y resonancias magnéticas, los usuarios están contribuyendo directamente al entrenamiento de modelos de IA, lo que significa que sus datos podrían ser utilizados para otros fines sin su consentimiento explícito.

Aunque algunas plataformas pueden garantizar que los datos se usan de manera anónima, no siempre es posible asegurar que la información personal no se filtrará o será accesible a terceros. Además, algunas empresas pueden cambiar sus políticas de privacidad en el futuro, lo que podría generar nuevas preocupaciones sobre la seguridad de la información almacenada.

- El potencial de exposición a terceros

Otra de las preocupaciones más graves relacionadas con la carga de imágenes médicas a plataformas de IA es la posibilidad de que los datos sean compartidos con terceros, como empleadores, proveedores de servicios médicos o incluso agencias gubernamentales. Debido a que muchas plataformas de IA recopilan grandes cantidades de datos de los usuarios, no es difícil imaginar un escenario en el que los datos médicos privados sean accesibles a personas que no tienen autorización para verlos.

Este riesgo se ve amplificado por la falta de transparencia en las políticas de privacidad de las plataformas. Aunque algunas empresas aseguran que la información se mantiene privada, la realidad es que los usuarios a menudo no tienen control sobre cómo se utilizan sus datos o quién tiene acceso a ellos.

- El almacenamiento de datos a largo plazo

Es importante recordar que lo que subes a Internet generalmente nunca desaparece. Incluso si eliminas tus datos de una plataforma de IA, existe la posibilidad de que la información se haya almacenado en cachés o copias de seguridad, lo que podría permitir que se acceda a ella en el futuro. En muchos casos, las plataformas de IA no garantizan que los datos eliminados sean completamente borrados de sus servidores.

Este es un factor crucial a tener en cuenta cuando se cargan datos médicos sensibles. Si no tienes control total sobre lo que sucede con tus imágenes médicas, podrías enfrentar problemas relacionados con la exposición de información privada en el futuro.

- El caso de Grok y X: Transparencia y privacidad

En octubre de 2024, Elon Musk, propietario de X, promovió la carga de imágenes médicas a Grok, el chatbot de IA de la plataforma, con el objetivo de que el modelo se volviera más preciso en la interpretación de resultados médicos. Aunque Musk afirmó que los resultados de Grok aún están en una etapa temprana, y que la inteligencia artificial mejoraría con el tiempo, muchos usuarios se han mostrado escépticos ante la falta de claridad sobre cómo se manejan sus datos.

La política de privacidad de X menciona que la plataforma comparte algunos datos personales con empresas “relacionadas”, pero no se especifica quiénes son estos terceros ni qué tan accesible es la información médica. Este tipo de falta de transparencia puede generar desconfianza entre los usuarios y resaltar los riesgos asociados con la carga de datos médicos a plataformas de IA.

¿Qué puedes hacer para proteger tu información médica?

Si bien la IA puede ser útil para obtener respuestas rápidas sobre cuestiones médicas, es fundamental que los usuarios comprendan los riesgos antes de compartir sus datos personales. Aquí hay algunas recomendaciones para proteger tu información médica en el mundo digital:

- Evita subir imágenes médicas a plataformas no verificadas

La forma más segura de proteger tu información es evitar cargar imágenes médicas a plataformas que no están específicamente diseñadas para manejar datos médicos de manera segura. Utiliza servicios en línea que cumplan con las leyes de privacidad y que ofrezcan garantías claras sobre la protección de tus datos.

- Consulta siempre con profesionales médicos

Si tienes dudas sobre tu salud o necesitas interpretar un resultado médico, siempre es recomendable que acudas a un profesional médico capacitado. Los médicos están obligados por la ley a proteger tu privacidad y tienen la experiencia necesaria para interpretar tus resultados de manera adecuada.

- Revisa las políticas de privacidad

Si decides utilizar plataformas que ofrecen servicios relacionados con la interpretación de imágenes médicas, asegúrate de revisar cuidadosamente sus políticas de privacidad. Asegúrate de comprender cómo se recopilan y utilizan tus datos, y qué medidas de seguridad existen para protegerlos.

- Considera alternativas seguras

Existen plataformas específicas para profesionales de la salud que garantizan la protección de los datos y cumplen con las regulaciones de privacidad, como HIPAA. Utilizar estos servicios especializados puede ofrecer una mayor seguridad que las aplicaciones de consumo general.

Piensa dos veces antes de cargar tus imágenes médicas

Aunque la inteligencia artificial ofrece un gran potencial para mejorar el diagnóstico y el cuidado de la salud, es crucial ser consciente de los riesgos asociados con la carga de imágenes médicas a plataformas no reguladas. La protección de la privacidad de los datos médicos debe ser una prioridad para todos los usuarios, y es importante tomar decisiones informadas sobre cómo se comparte y se maneja esa información.

Recuerda, lo que subes a Internet puede permanecer en línea de manera indefinida. Protege tu privacidad y la de tu salud evitando cargar datos médicos a plataformas de IA que no garanticen una seguridad adecuada.