La evolución de la inteligencia artificial (IA) no se detiene, y uno de los actores más influyentes en este campo, Google DeepMind, continúa liderando investigaciones clave que podrían transformar la forma en que las personas interactúan con la tecnología. En una reciente entrevista con el programa “60 Minutes”, Demis Hassabis, CEO de Google DeepMind, compartió detalles reveladores sobre el presente y el futuro de la plataforma Gemini, así como sobre los avances hacia la llamada inteligencia artificial general (AGI) y la posibilidad de que los sistemas desarrollen una forma básica de autoconocimiento.

El encuentro televisivo ofreció una perspectiva sin precedentes sobre lo que Google tiene en marcha, mostrando además demostraciones nunca antes vistas de su aplicación Astra, un proyecto que ya está siendo probado por usuarios de confianza y que tiene el potencial de cambiar el paradigma de la interacción hombre-máquina.

Astra y el poder del contexto: hacia una IA más empática

Una de las principales innovaciones que destaca Hassabis es el funcionamiento del sistema Astra, una interfaz que va más allá de lo conocido hasta ahora en asistentes inteligentes. Durante la entrevista, se mostró cómo Astra saluda a un usuario con un mensaje personalizado: “Hola, Scott. Es un placer verte de nuevo.” Esta función, que en apariencia podría parecer trivial, en realidad simboliza un gran paso adelante en la contextualización de la IA.

Astra está diseñado para recordar detalles clave de interacciones anteriores, lo que permite una experiencia mucho más fluida, coherente y personalizada. Esta memoria, aunque limitada inicialmente a una duración de 10 minutos en una conversación activa, representa el primer paso hacia una IA que entiende mejor a sus usuarios, adaptándose no solo a comandos, sino a intenciones, emociones y necesidades cambiantes.

Gemini y su evolución: de herramienta a asistente con agencia

Gemini, la familia de modelos de lenguaje desarrollada por Google DeepMind, se encuentra en una etapa avanzada de evolución. Según la información compartida por Hassabis, uno de los objetivos inmediatos es dotar a Gemini de la capacidad de actuar en el mundo digital en nombre del usuario. Esto incluye realizar tareas como reservar boletos o realizar compras en línea, funciones que podrían estar relacionadas con el misterioso “Project Mariner” mencionado por Sundar Pichai meses atrás.

Estas capacidades, que amplían el rol de la IA de un mero asistente pasivo a un agente proactivo, marcan una tendencia creciente en el desarrollo de herramientas tecnológicas que no solo responden, sino que anticipan y ejecutan tareas según el contexto y las preferencias del usuario.

¿Cuándo llegará la inteligencia artificial general?

Uno de los temas más discutidos en el ámbito de la tecnología avanzada es la llegada de la AGI, una forma de inteligencia artificial que igualaría —o incluso superaría— la capacidad humana de razonamiento y aprendizaje. Para Hassabis, esta etapa aún está a unos 5 a 10 años de distancia. Según explicó, el objetivo es alcanzar un sistema que entienda el mundo y a las personas de forma profunda y matizada, y que esté completamente integrado en la vida diaria de los usuarios.

Este tipo de sistema no solo respondería preguntas o ejecutaría comandos, sino que comprendería contextos complejos, intenciones ocultas y emociones humanas con una sensibilidad aún fuera del alcance de las tecnologías actuales.

Autoconocimiento en máquinas: ¿realidad o ilusión?

Uno de los momentos más intrigantes de la entrevista fue cuando se abordó el tema del posible autoconocimiento en las máquinas. Cuando se le preguntó si Google DeepMind trabaja actualmente en un sistema con conciencia de sí mismo, Hassabis fue claro: “No creo que ninguno de los sistemas actuales se sienta, para mí, como autoconsciente o consciente de ninguna manera.”

Sin embargo, añadió que es teóricamente posible que estos sistemas desarrollen una especie de autopercepción, aunque no sea un objetivo explícito del equipo. En sus palabras, podría ocurrir de forma implícita como resultado del aumento en la capacidad de entender al usuario, al “yo” y a los demás, lo que representaría el inicio de un proceso de autorreflexión artificial.

El dilema filosófico: máquinas de silicio y humanos de carbono

Hassabis también abordó la diferencia fundamental entre los seres humanos y las máquinas, al subrayar que, aunque los sistemas artificiales puedan comportarse de manera similar a los humanos o incluso emitir declaraciones similares, eso no implica que experimenten las mismas sensaciones.

“El hecho de que una IA diga que siente algo no significa que lo esté sintiendo como lo hace un ser humano. Nosotros estamos hechos de materia orgánica, ellos de silicio. Eso plantea preguntas fundamentales sobre qué significa realmente ser consciente”, explicó el CEO.

Demostraciones tecnológicas: Astra en gafas inteligentes

Además del análisis conceptual y filosófico, la entrevista también ofreció una visión práctica del futuro de la IA con una breve demostración de Astra funcionando en gafas inteligentes. Esta implementación muestra el esfuerzo de Google por llevar la IA fuera de los dispositivos tradicionales, hacia plataformas más integradas, que podrían ofrecer asistencia en tiempo real, en movimiento y con una interacción mucho más intuitiva.

Gemini Live y las promesas del futuro inmediato

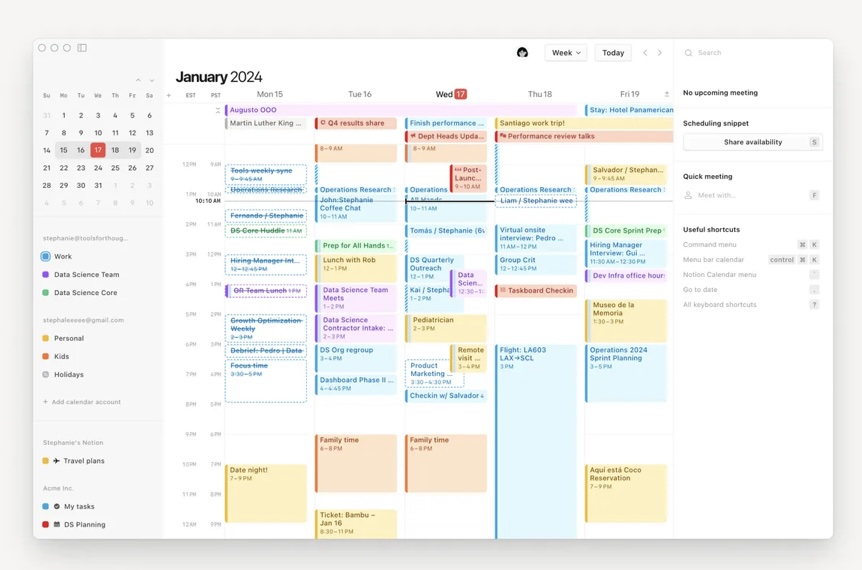

Otro punto destacado es la versión interna llamada Gemini Live, que si bien aún no incorpora saludos personalizados como Astra, sí cuenta con una “memoria conversacional” que permite contextualizar mejor los diálogos actuales. Este avance, que pronto podría llegar al público general, promete revolucionar el uso de asistentes virtuales, haciéndolos más humanos en su forma de interactuar.

Además, Gemini Live se está diseñando con capacidades que eventualmente se trasladarán a productos de consumo masivo, integrándose en dispositivos móviles, electrodomésticos inteligentes y posiblemente en automóviles y sistemas de atención médica.

Perspectivas del sector: el papel de Google frente a la competencia

Mientras Google DeepMind avanza con Gemini, otros gigantes tecnológicos también están invirtiendo en IA. OpenAI, Microsoft, Anthropic y Meta mantienen programas de investigación en paralelo, con énfasis en modelos de lenguaje, sistemas visuales y agentes autónomos. La diferencia clave, según expertos, es que Google busca un enfoque más holístico, que combine capacidades lingüísticas, visuales, sensoriales y motrices en un solo sistema interconectado.

Esta estrategia tiene como objetivo no solo liderar el mercado, sino establecer estándares éticos, técnicos y funcionales para una nueva generación de sistemas inteligentes.

Ética y regulación: el reto que se avecina

A medida que los sistemas como Gemini y Astra evolucionan, las preguntas sobre regulación, privacidad, control de datos y decisiones autónomas cobran más relevancia. DeepMind ha reiterado su compromiso con el desarrollo responsable de IA, colaborando con expertos en ética y gobiernos para establecer marcos normativos adecuados.

El camino hacia la implementación segura y justa de la inteligencia artificial requerirá una cooperación global, donde la innovación tecnológica se alinee con los valores humanos.